La traduction de cette page n'est pas à jour. Cliquez ici pour voir la dernière version en anglais.

cascadeforwardnet

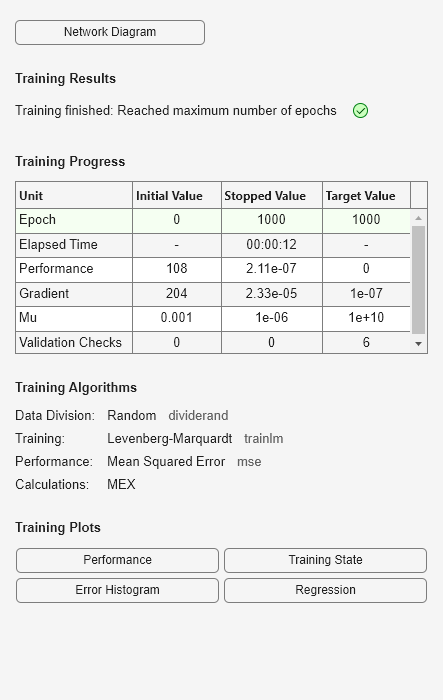

Générer un réseau de neurones feedforward en cascade

Description

net = cascadeforwardnet(hiddenSizes,trainFcn)hiddenSizes et une fonction d’apprentissage, spécifiée par trainFcn.

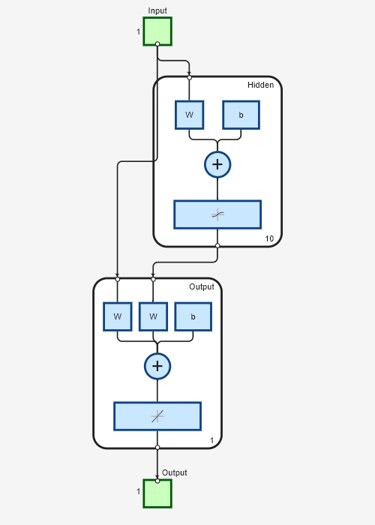

Les réseau feedforward en cascade sont similaires aux réseaux feedforward si ce n’est qu’ils comportent une connexion depuis la couche d'entrée et chaque couche précédente, vers les couches suivantes.

Tout comme pour les réseaux feedforward, un réseau en cascade à au moins deux couches peut apprendre n'importe quelle relation entrée/sortie finie de manière arbitraire, à condition que le nombre de neurones cachés soit suffisant.

Exemples

Arguments d'entrée

Arguments de sortie

Historique des versions

Introduit dans R2010b